Prvog lipnja 2017. godine Arcade Fire objavljuju pjesmu Everything Now. Kao što je pjesma sugerirala, činilo se da cijeli svijet imamo na dohvat vrhova prstiju. Misli se, naravno, na sveobuhvatni internet: što god tražimo, u džepu nam je.

Je li u tom smislu njihov stih “We’ve got everything now” istinit? Istina je zapravo zanimljivija.

Plinije Stariji oko 77. godine dovršio je djelo Naturalis Historia (Prirodoslovlje). Sastojalo se od 37 knjiga i obuhvaćalo sve što je rimski svijet tada znao: astronomiju, matematiku, geografiju, etnografiju, antropologiju, zoologiju, botaniku, poljoprivredu, medicinu, rudarstvo i umjetnost. Plinije je tvrdio da je prikupio dvadeset tisuća činjenica iz dvije tisuće knjiga od stotinu različitih autora. Ovo se djelo stoljećima smatralo vrhovnim autoritetom za ljudsko znanje u Europi. Netko ga je, sigurno, uzeo u ruke i pun veličajne zahvalnosti prošaptao (na latinskom): “We’ve got everything now!“

Kao mali sam imao sličan osjećaj kad bih ušao u knjižnicu. Nekad su se ozbiljnije domaće zadaće, u kojima je trebalo nešto istražiti, rješavale odlaskom u knjižnicu, zbirku ljudskog znanja. Nepregledne police knjiga o svemu i svačemu: ovdje je sve, pomislio sam. Imamo sve!

Na jednoj od tih polica stajale su knjige o šahu, a znanje o otvaranjima i završnicama tražilo se u njima. Ali ondje nije baš SVE pisalo, jer broj mogućih pozicija u šahu usporediv je s brojem atoma u svemiru. Kad su se pojavili moćni šahovski programi poput Stockfisha, nije više trebalo zavirivati u knjige. Za bilo koji potez bilo koje partije odmah saznajemo što treba igrati. Everything Now.

U srednjoj školi, a i poslije, bavio sam se matematičkim i informatičkim natjecanjima. Svaki zadatak jedna je zagonetka, na koju često nisam znao odgovoriti, pa bih tražio rješenja. U slučaju matematike najprije po knjigama, a onda i na internetu kako je sve više rješenja postajalo dostupno na Mathlinksu/AoPS-u i njegovim forumima. Everything Now.

Informatički zadatci drugačija su priča; nije bilo dostupnih rješenja na online judgevima (zbirkama zadataka) poput Spoj-a, morali smo ih sami pisati i automatski evaluirati. Čak i ako je bio dostupan opis algoritma, on je samo dio rješenja: trebalo ga je isprogramirati, što je ponekad i teži dio. Everything Now?

Prije deset godina, velik dio programiranja u širem smislu (softverskog inženjerstva), pogotovo s tehnologijama u kojima nisi bio ekspert, svodio se na guglanje, traženje određene informacije. Kako se nešto zove, kako nešto napraviti, zašto nešto ne radi i tako dalje. Stranica s takvim pitanjima i odgovorima korisnika (kao forum ili reddit) zvala se Stack Overflow i na njoj smo pronalazili rješenja za mnoge stvari koje smo guglali. Većina korisnika, pa tako i ja, koristila je tu stranicu samo za čitanje odgovora, ne i za postavljanje pitanja. Ako naše pitanje ondje nitko prije nije postavio, odgovor smo tražili drugdje: nismo sami objavljivali pitanje jer nismo imali vremena čekati da nam netko odgovori. Odgovor smo trebali ODMAH i nije ga uvijek bilo. Everything Now?

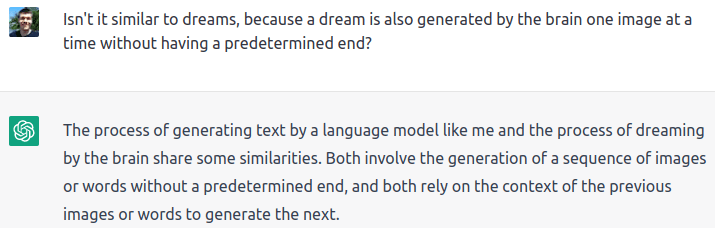

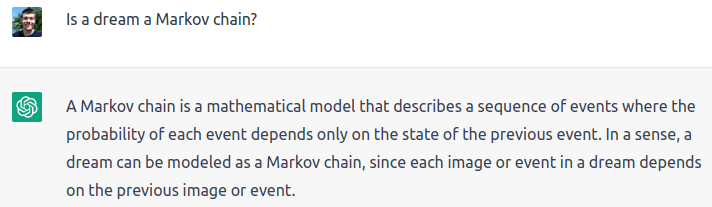

Deset dana nakon što su Arcade Fire objavili spomenuti singl, na arXiv-u je objavljen znanstveni rad Attention Is All You Need istraživača iz Googlea koji je predstavio transformer arhitekturu na kojoj se temelje današnji AI modeli. I sada… su stvari “na dohvat vrhova prstiju” na jednoj sasvim drugoj razini nego te 2017. godine. Ne samo da nam robot odmah odgovara na pitanje kojeg nema na Stack Overflowu, nego i programira umjesto nas. Rješava i otvorene (prethodno neriješene) probleme koje su matematičari bezuspješno napadali. Za informacije ne trebamo ići u knjižnicu, ne trebamo čak ni guglati, on to čini umjesto nas. I ne samo da (kao 2017.) imamo svu glazbu, sve slike, video igre, aplikacije i tako dalje, nego ih stvaramo po vlastitom ukusu, odmah. Everything Now?

Valjda ste već shvatili da je odgovor ne. Ni približno! Kao što je onaj rimski čitatelj s Plinijevom knjigom u ruci pomislio da ima sve, jer nije mogao zamisliti više, i kao što Arcade Fire nisu imali na umu ovu sljedeću, za kvantni skok višu razinu značenja svoje fraze, tako samo rijetki od nas zamišljamo ono što je iduće. A bit će ga, itekako, i više nego što zamišljam. Everything Now nije tvrdnja o obilju, nego o granici imaginacije. “Sve” znači samo ono što znamo prebrojiti.